ארכיטקטורת Headless CMS משנה את כללי המשחק בעולם הפיתוח – אבל בלי אופטימיזציה קפדנית לקידום אתרים, היתרונות הטכנולוגיים עלולים להפוך לחיסרון תחרותי. במדריך המקיף הזה תגלו בדיוק איך לבנות אתר Headless שלא רק מרשים מבחינת ביצועים, אלא גם מדורג גבוה בגוגל – עם כל הטיפים, הטעויות הנפוצות והפתרונות המעשיים שנצברו מניסיון אמיתי.

- 01 אתר Headless לא משפר SEO אוטומטית – נדרשת בנייה מכוונת של כל רכיב טכני

- 02 רינדור SSG או ISR מספקים את האיזון הטוב ביותר בין מהירות לנגישות לבוטים

- 03 מודל תוכן עם שדות SEO מובנים הוא הבסיס להצלחה ארוכת טווח

- 04 מיגרציה מתוכננת עם מפת 301 מסודרת שומרת על הדירוגים הקיימים

- 05 ניטור שוטף של אינדוקס, ביצועים ומדדי Core Web Vitals הוא חובה מתמשכת

מה זה בעצם Headless CMS ולמה זה משנה את כל מה שידעתם על SEO?

בואו נתחיל מהבסיס. Headless CMS זו ארכיטקטורה שבה מפרידים לגמרי בין שכבת התוכן (הבק-אנד, שם יושב ה-CMS) לבין שכבת התצוגה (הפרונט-אנד, מה שהמשתמש רואה). התוכן מגיע דרך API ונבנה בטכנולוגיות פרונט מודרניות כמו Next.js או Gatsby. זה נותן גמישות מטורפת, אבל (ותמיד יש אבל) – זה גם מעביר את כל האחריות על רכיבי ה-SEO לצוות הפיתוח.

באתר מסורתי – וורדפרס, למשל – יש לכם תוסף Yoast או RankMath שמטפל אוטומטית בכותרות מטא, ב-canonical, ב-sitemap. ב-Headless? אין כזה דבר. כל שדה SEO חייב להיות מוגדר כחלק ממודל התוכן עצמו, וחייבים לוודא שהפרונט מרנדר את זה ל-HTML אמיתי – כזה שבוטים של גוגל באמת יצפו לראות. אם זה לא ב-HTML, זה לא קיים מבחינת גוגל.

האם אתר Headless "טוב יותר" ל-SEO באופן אוטומטי?

התשובה הקצרה: לא. ממש לא. הנה, אמרתי את זה. הרבה אנשים חושבים שאם הם עוברים ל-Headless, האתר שלהם פתאום יקפוץ בדירוגים. האמת המרה היא שללא אופטימיזציה נכונה בשכבת הפרונט, אתר Headless יכול לביצועי SEO גרועים יותר מאתר וורדפרס פשוט.

מצד אחד, יש יתרונות ברורים: שליטה מלאה בקוד ה-HTML, פוטנציאל לביצועים גבוהים יותר ומדדי Core Web Vitals משופרים. מצד שני, אין "ברירת מחדל" שמטפלת בכללי SEO. כל טעות ברינדור, בקנוניקל או בסייטמאפ – היא על אחריותכם בלבד. שירותים מקצועיים כמו אלו שמספקת WEBFORCE מבית Webs מאפשרים להתמודד עם האתגרים האלה בדיוק, בלי לשלם מחיר בדירוגים.

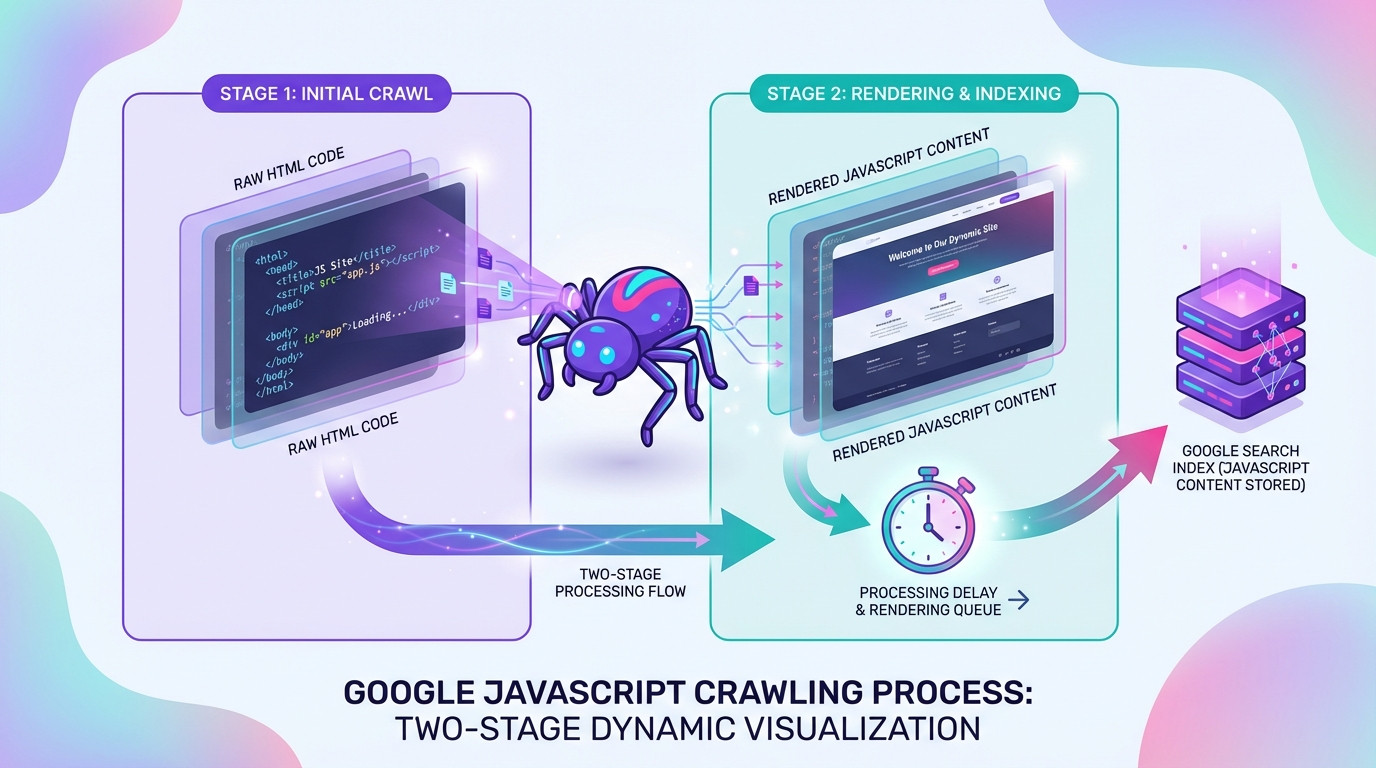

איך גוגל סורק ומאנדקס אתר Headless שמבוסס JavaScript?

גוגל יכולה לרנדר JavaScript – זה נכון. אבל "יכולה" זה לא "תמיד עושה את זה מושלם". Googlebot עובד בשני שלבים: קודם הוא סורק את ה-HTML הראשוני, ורק אחר כך – לפעמים עם עיכוב של ימים – מריץ את ה-JavaScript כדי לראות את התוכן המלא. תוכן שתלוי לחלוטין ב-Client-Side Rendering עלול לסבול מעיכובים משמעותיים בגילוי ובאינדוקס.

הבעיות הנפוצות ביותר: תוכן שמופיע רק לאחר קריאות API, קישורים שאינם נגישים לבוטים כי הם מוזרקים דרך JS, ותגיות מטא שמגיעות מאוחר מדי. ה-HTML הראשוני צריך להיות עשיר ככל האפשר. כך גוגל עצמם מסבירים בתיעוד שלהם על JavaScript SEO.

מתי JavaScript גורם לבעיות SEO וכיצד להימנע מהן?

הכלל הראשון: וודאו שמשאבים קריטיים – קבצי JS, CSS ותמונות – אינם חסומים ב-robots.txt. גוגל צריכים גישה לכל המשאבים האלה כדי לרנדר את הדף כראוי. הפתרונות הנפוצים הם רינדור צד-שרת (SSR) או יצירת אתרים סטטיים (SSG), ששניהם מבטיחים ש-HTML עשיר מגיע לבוט כבר בשלב הסריקה הראשונית. Dynamic Rendering עדיין קיים כמעקף, אבל הוא פחות נדרש כיום ברוב המקרים.

השוואה: SSG, SSR או ISR – מה עדיף לקידום אתרים?

בשורה התחתונה: רינדור סטטי או היברידי לרוב מספקים את האיזון הטוב ביותר לקידום Jamstack. SSG נותן פחות סיכון ל"תוכן לא נגיש לבוט" ומהירות מרבית, בעוד ISR (כמו ב-Next.js) מאפשר דפים סטטיים שמתעדכנים מעת לעת בלי צורך ב-build מחדש של כל האתר.

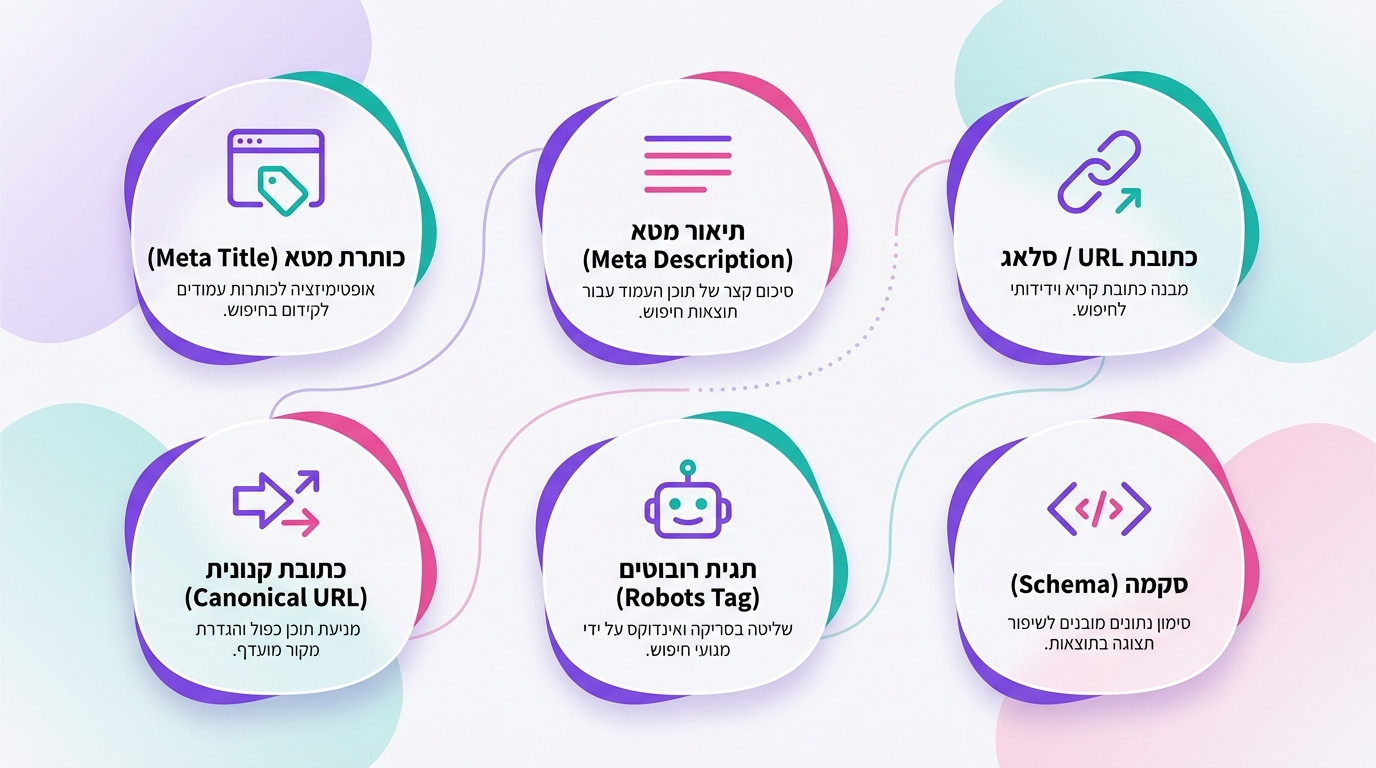

בניית מודל תוכן שמשרת Headless SEO – השדות שחייבים להיות שם

אחד הדברים שלמדתי אחרי עבודה עם עשרות אתרי Headless: אם לא הגדרתם שדות SEO מראש כחלק מהיישות התוכנית – תשלמו על זה אחר כך. הנה השדות שחייבים להיות בכל מודל תוכן:

- —Meta Title – נפרד מ-H1, עם הגבלת תווים מובנית

- —Meta Description – תיאור ייחודי לכל דף, עם מונה תווים

- —Slug/URL – כתובת ידידותית עם ולידציה למניעת שכפול

- —Canonical URL – עם ברירת מחדל אוטומטית ואפשרות לחריגים ידניים

- —Robots Tag – בחירה בין index/noindex עם אזהרה מובנית

- —Open Graph + Twitter Card – לשיתוף מיטבי ברשתות חברתיות

- —Schema – שדות ייעודיים לנתונים מובנים

- —Alt Text – שדה חובה לכל תמונה, ללא יוצא מהכלל

הולידציות חשובות לא פחות: אורך כותרת מקסימלי, מניעת שכפול Slug, חובה ל-H1 יחיד, ומנגנון אזהרה שמונע noindex בטעות.

ניהול מטא טייטל ודיסקריפשן – הטעות שכולם עושים

הטעות הכי נפוצה שאני רואה: אנשים בונים אתר Headless מדהים, ואז שוכחים לטפל בתגיות המטא. או שהם משאירים ברירת מחדל גנרית לכל הדפים, או שהתגיות מוזרקות דרך JS מאוחר מדי ו-Googlebot לא תופס אותן.

הגישה הנכונה: שדות ייעודיים במודל התוכן לכל סוג עמוד, תבניות Fallback חכמות למקרה שלא מולאו ידנית (למשל: "[שם המוצר] – קנו עכשיו ב[שם האתר]"), ומיפוי תקין בין סוג תוכן לתבנית תגיות. לדפים חשובים – תמיד כתבו כותרות ותיאורים ייחודיים ואל תסתמכו על ברירת מחדל.

קנוניקל באתר Headless – כך מונעים שגוגל יתבלבל

ב-Headless קל מאוד לייצר וריאציות URL: פרמטרים של מיון, סינון, עימוד, גרסאות שפה. בלי כלל קנוניקל אחיד – נוצרת קניבליזציה ושכפול תוכן שיפגעו בדירוגים. הפתרון: הגדרת כלל canonical אחיד בפרונט-אנד שברירת מחדל מצביע על ה-URL הנקי של הדף, עם אפשרות לדרוס ידנית כשצריך.

הדבר הקריטי: תוודאו שהפרונט מייצר את תגית ה-canonical ב-HTML עצמו, ולא רק דרך JavaScript שמוזרק בצד הלקוח. גוגל מפרטים את המנגנון בתיעוד על איחוד כתובות URL כפולות.

Sitemap דינמי – האם ה-Sitemap שלכם באמת מתעדכן?

באתר Headless, ה-sitemap חייב להיווצר מחדש בכל פרסום או עדכון תוכן. זה לא כמו וורדפרס שבו תוסף מטפל בזה בשבילכם. יש לבנות סקריפט או פונקציה שמושכת את כל ה-URL-ים האינדקסביליים מה-API ומייצרת sitemap XML תקני.

כללים חשובים: לכלול רק URL-ים שבאמת צריכים להיות באינדקס (לא דפי noindex, לא דפי redirect). להפריד sitemaps לפי סוגי תוכן או שפות באתרים גדולים. ולהקפיד על תגית lastmod אמינה – כלומר, כזו שמשקפת תאריך עדכון אמיתי ולא סתם תאריך נוכחי. גוגל שמים לב לזה.

חמש טעויות robots שיכולות להרוס לכם את האינדוקס

ראיתי את כולן, תאמינו לי. הנה הטעויות הנפוצות ביותר בהגדרת robots ותגיות noindex באתרי Headless:

טעות 1: noindex גלובלי שנשאר מסביבת Staging ועולה לפרודקשן. זה קורה הרבה יותר ממה שאתם חושבים.

טעות 2: חסימת קבצי CSS ו-JS ב-robots.txt, מה שמונע מ-Googlebot לרנדר את הדף כראוי.

טעות 3: בלבול בין robots.txt (חסימת סריקה) לתגיות מטא robots (חסימת אינדוקס) – אלה שני דברים שונים לגמרי.

טעות 4: שכחו להוסיף תגית robots בכלל, כך שכל דף נשאר על index כברירת מחדל – כולל דפי תודה ודפי 404 מותאמים.

טעות 5: הגדרות robots שמגיעות דרך JavaScript בלבד ולא ב-HTML הראשוני.

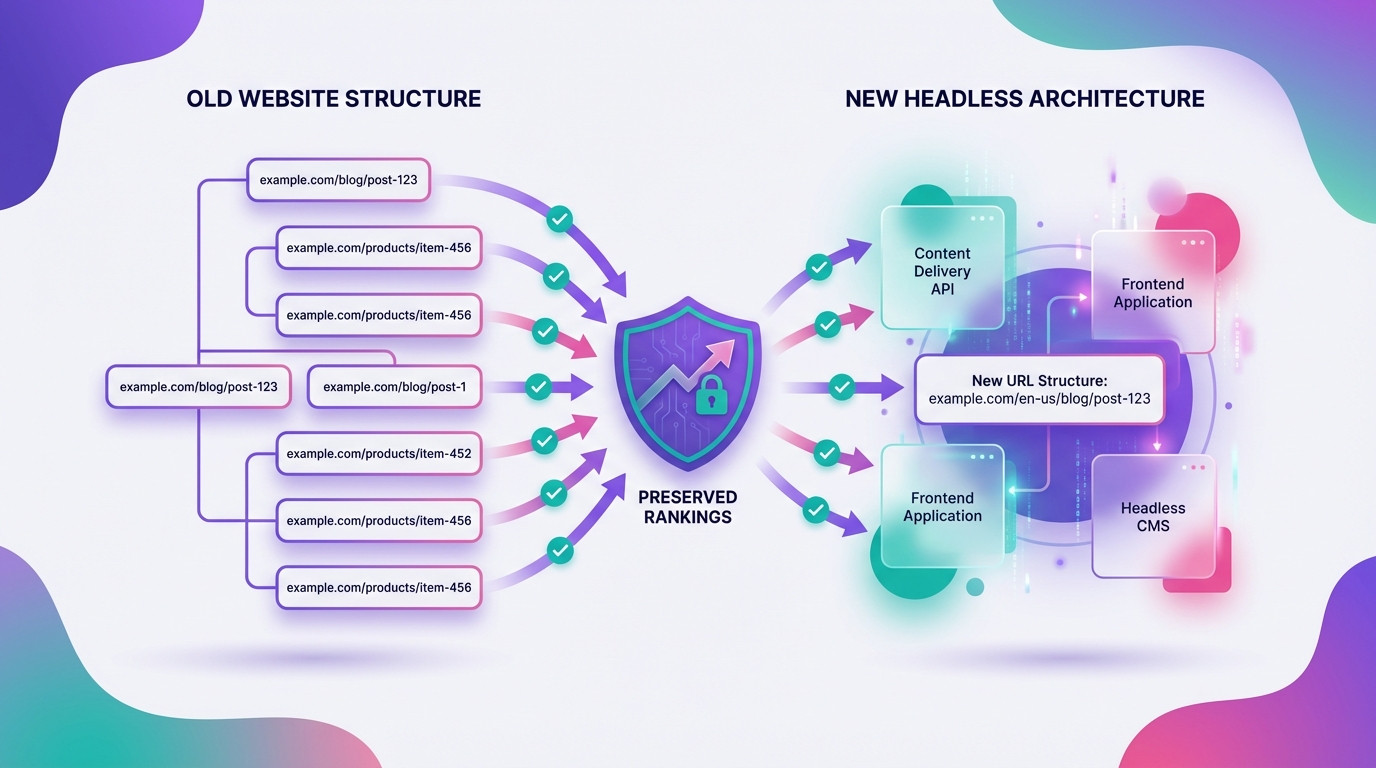

מעבר ל-Headless – מפת ההפניות 301 שתציל את הדירוגים שלכם

מיגרציה לארכיטקטורת Headless היא רגע קריטי. אם לא תתכננו את מפת ההפניות 301 לפני העלייה לאוויר – תאבדו תנועה אורגנית. ככה זה עובד:

חשוב לטפל גם בפרמטרים ולוודא שהקנוניקל תקין בכל הדפים החדשים. ניטור אינטנסיבי בימים ובשבועות הראשונים הוא לא אופציה – הוא חובה.

כותרות H1 ו-H2 שנשברות בעיצוב – בעיה שאף אחד לא מדבר עליה

באתרי Headless, מעצבים אוהבים לשלוט בגודל טקסט דרך קלאסים של CSS. התוצאה? כותרת שנראית כמו H2 אבל בקוד היא div. או H1 כפול כי הלוגו עטוף ב-H1 והכותרת הראשית גם. הפתרון הוא הפרדה ברורה בין סמנטיקה לעיצוב: הכותרת חייבת להיות תגית HTML נכונה בהיררכיה הגיונית.

מומלץ להגדיר קומפוננטות כותרת בפרונט שמכריחות היררכיה תקינה ומונעות דילוגים – למשל, שאי אפשר לשים H3 בלי H2 לפניו. גישה זו מבטיחה שהסמנטיקה של הדף תמיד תקינה, ללא תלות בהחלטות עיצוביות.

נתונים מובנים (Schema) באתר Headless – שליטה מלאה שדורשת אחריות מלאה

היתרון הגדול של Headless בהקשר של Schema: שליטה מלאה. אתם מגדירים שדות Schema במודל התוכן, יוצרים גנרטור בפרונט שמוציא JSON-LD עקבי, ומקבלים נתונים מובנים בדיוק כמו שגוגל רוצה לראות אותם. סוגי Schema נפוצים לתוכן אינפורמטיבי כוללים Article, BlogPosting, BreadcrumbList, FAQPage ו-Organization.

אבל – וזה אבל גדול – בלי QA הדוק, קל מאוד לייצר שגיאות. שדה ריק, URL שבור בתוך ה-Schema, או סוג Schema שלא תואם את התוכן בפועל. בדיקה שוטפת עם כלי הבדיקה של גוגל היא הכרחית.

תמונות ב-Headless: Alt, משקל ו-Lazy Loading – התלת-ראש של הביצועים

Alt Text הוא לא רק עניין של נגישות – הוא עוזר למנועי חיפוש להבין מה יש בתמונה. שדה Alt חייב להיות חובה במערכת התוכן, ולא אופציונלי. משקל תמונה משפיע ישירות על מהירות הטעינה ועל Core Web Vitals – השתמשו בפורמטים מודרניים כמו WebP או AVIF ובשינוי גודל אוטומטי. Lazy Loading הוא נהדר לתמונות שמתחת לקפל, אבל הנה הכלל הזהב: אל תעשו lazy-load לתמונת LCP – התמונה הגדולה ביותר בחלק העליון של הדף. זה יפגע ישירות במדד Largest Contentful Paint שלכם.

ב-WEBFORCE מבית Webs, תהליכי האופטימיזציה של תמונות מוטמעים כחלק מהפתרון הכולל – כולל התאמת פורמטים, דחיסה אוטומטית ובדיקת Alt Text חסר.

קישורים פנימיים ב-Headless – אסטרטגיה שמתחילה במודל התוכן

קישורים פנימיים הם אחד הכלים החזקים ביותר בקידום אורגני, ודווקא ב-Headless קל לאבד שליטה עליהם. הפתרון: הגדרת "שדות קשרים" בין סוגי תוכן שונים כבר ב-CMS. מאמר מקושר למאמרים רלוונטיים, מוצר מקושר למוצרים משלימים – הכל דרך שדות מובנים שהפרונט שולף ומציג כקישורי HTML אמיתיים.

הדגש הקריטי: הקישורים חייבים להיות חלק אינטגרלי מה-HTML המרונדר ולא רק אלמנטים שנטענים דרך JavaScript בצד הלקוח. שימוש אסטרטגי בקישורים פנימיים מחזק את סמכות הדפים ומסייע ליעדי העסק – תוכלו לקרוא עוד על כיצד קידום אורגני מקיף מסייע ליעדי העסק.

מה מודדים ב-Headless SEO ואיך יודעים שזה עובד?

המדדים שחשוב לעקוב אחריהם באופן שוטף:

- —תנועה אורגנית – האם יש גידול בביקורים לדפים רלוונטיים?

- —דירוגים – האם ביטויי המפתח זזים למעלה?

- —מדדי אינדוקס – כמה דפים תקפים מופיעים ב-Search Console מול כמה נדחו?

- —Core Web Vitals – LCP, INP, CLS – האם הם ב"ירוק"?

- —יחס קליקים (CTR) – האם אנשים לוחצים על התוצאות שלכם?

הכלים הבסיסיים לניטור: Google Search Console לטכני ואינדוקס, Google Analytics לתנועה והתנהגות, ופקודות חיפוש כמו site: ו-cache: לאימות מהיר. מעבר לכך, כלים כמו Lighthouse עוזרים לזהות צווארי בקבוק בביצועים, כפי שמוסבר ב-המדריך של web.dev לאופטימיזציה.

כמה זמן התאוששות צפוי אחרי מיגרציה ל-Headless?

זה תלוי באיכות המיגרציה, אבל בואו נהיה ריאליסטיים: לרוב מדובר במספר שבועות עד מספר חודשים. הגורמים שמשפיעים הם מספר ההפניות 301, היקף שינויי ה-URL ומבנה האתר, בעיות טכניות שצצות (וכמעט תמיד צצות), ואיכות הטיפול ברכיבי Headless SEO כמו קנוניקל ו-sitemap.

ההמלצה שלי: ניטור אינטנסיבי בימים ובשבועות הראשונים, עם תגובה מהירה לכל בעיה שעולה. אל תמתינו חודש כדי לבדוק – בדקו כל יום בשבוע הראשון.

האם בחירת ה-CMS עצמו משפיעה על הדירוגים?

הנה סוד קטן: בחירת ה-CMS – בין אם זה Contentful, Strapi, Sanity או כל מערכת אחרת – פחות משפיעה ישירות על הדירוגים מאשר היישום הטכני של שכבת הפרונט-אנד. ה-CMS הוא "מחסן התוכן". הוא חשוב לחוויית העריכה, לגמישות המודל ולזרימת העבודה – אבל מה שגוגל רואה זה את ה-HTML שהפרונט מייצר.

CMS טוב יאפשר בניית מודל תוכן עשיר עם כל שדות ה-SEO שצריך, אבל הביצוע – הרינדור, המהירות, הנגישות – הוא מה שקובע. אז תבחרו CMS שנוח לצוות שלכם, ותשקיעו את האנרגיה ביישום הפרונט.

שאלות נפוצות על קידום אתרים Headless CMS

Headless SEO – שווה את המאמץ, בתנאי שיש תוכנית

ארכיטקטורת Headless מציעה גמישות, ביצועים גבוהים, חוויית משתמש משופרת ופוטנציאל ליתרון תחרותי אמיתי בקידום אתרים. אבל היא דורשת מומחיות טכנית גבוהה, תכנון קפדני וניהול SEO אקטיבי. בלי כלים מתקדמים לניהול משימות SEO ובלי צוות שמבין את האתגרים הייחודיים – קל מאוד להיכשל.

- בדקו את המצב הנוכחי – כמה דפים באינדקס? מה מצב ה-Core Web Vitals? האם יש שגיאות טכניות?

- מפו את הדרישות – רשימה מלאה של רכיבי SEO שחייבים להיות מכוסים בארכיטקטורה החדשה

- בחרו גישת רינדור – SSG, SSR או ISR לפי סוג התוכן ותדירות העדכונים

- תכננו מפת הפניות – לפני שנוגעים בשורת קוד אחת של הפרויקט החדש

- הגדירו ניטור שוטף – כלים, מדדים ולוחות זמנים לבדיקה