אוקיי, בואו נדבר על משהו שהרבה בעלי אתרים מעדיפים לדלג עליו. כתבתם תוכן מדהים, השקעתם שעות במחקר מילות מפתח, ובכל זאת – הדירוגים לא זזים. אחרי שנים של עבודה עם מאות אתרים ישראליים, אני יכול להגיד לכם שבלא מעט מקרים הבעיה היא לא התוכן. הבעיה היא בתשתית הטכנית. SEO טכני מתקדם הוא מה שמבטיח שמנועי החיפוש בכלל יכולים להגיע לתוכן שלכם, להבין אותו, ולהציג אותו למי שמחפש. במדריך הזה נצלול לעומק של תהליכי אינדוקס וסריקה, נדבר על ביצועים ותיקוני קוד ל-SEO, ונסביר איך WEBFORCE מבית Webs עוזרת לעשות את כל זה בצורה שיטתית – בלי ללכת לאיבוד.

זמן קריאה משוער: 18 דקות | שווה כל שנייה

- ✓ ההבדל הקריטי בין סריקה, רינדור ואינדוקס – ואיך טעות אחת מוחקת עמודים מגוגל

- ✓ הטעויות הנפוצות ביותר ב-robots.txt, canonical ו-Sitemap שפוגעות בדירוגים

- ✓ Core Web Vitals – מה גוגל באמת מודדת ואיך לשפר מדדים בפועל

- ✓ תיקוני קוד ל-SEO: מתי חייבים לגעת בקוד ואיך לתעדף לפי השפעה עסקית

- ✓ לוח זמנים מעשי של 90 יום ל-Audit טכני מלא

מה זה SEO טכני מתקדם ולמה הוא לא רק "עניין של מתכנתים"?

SEO טכני מתקדם הוא סט פעולות שמוודא שמנועי חיפוש מצליחים לסרוק, לרנדר, להבין ולאנדקס את האתר שלכם ביעילות. זה כולל טיפול בבעיות אינדוקס, ניהול תוכן כפול וקנוניקל, תחזוקת קובצי robots.txt ו-sitemap.xml, שיפור Core Web Vitals, ניהול פרמטרים, נתונים מובנים (Schema Markup), ולעיתים גם התאמות ל-JavaScript ורינדור דינמי.

האמת המרה? אפשר לכתוב את המאמר הכי טוב בעולם על נושא מסוים, אבל אם האתר חוסם את גוגל מלסרוק אותו, או שהדף נטען כל כך לאט שהבוט "מתייאש" – התוכן הזה פשוט לא קיים מבחינת מנוע החיפוש. אופטימיזציה טכנית היא הבסיס שבלעדיו שום אסטרטגיית תוכן לא תעבוד כמו שצריך.

תרחיש מהשטח: תוכן מעולה שנעלם מהתוצאות

נתקלתי לא פעם בתרחיש הבא: לקוח מגיע עם אתר שיש בו עשרות מאמרים איכותיים, עמודי מוצר מפורטים, ותוכן שהושקעו בו שעות. אבל כשבודקים ב-Google Search Console – חצי מהעמודים לא מאונדקסים. הסיבות? עמודים חשובים קיבלו canonical לא נכון שהפנה לעמוד אחר. חלק היו חסומים ב-noindex בטעות. ואחרים נטענו כל כך לאט שגוגל פשוט זנח את הסריקה שלהם.

זו בדיוק הנקודה: קידום טכני הוא לא "בונוס" – הוא תנאי הכרחי. בלי אופטימיזציה טכנית תקינה, אתם בעצם משקיעים בתוכן שאף אחד לא יראה.

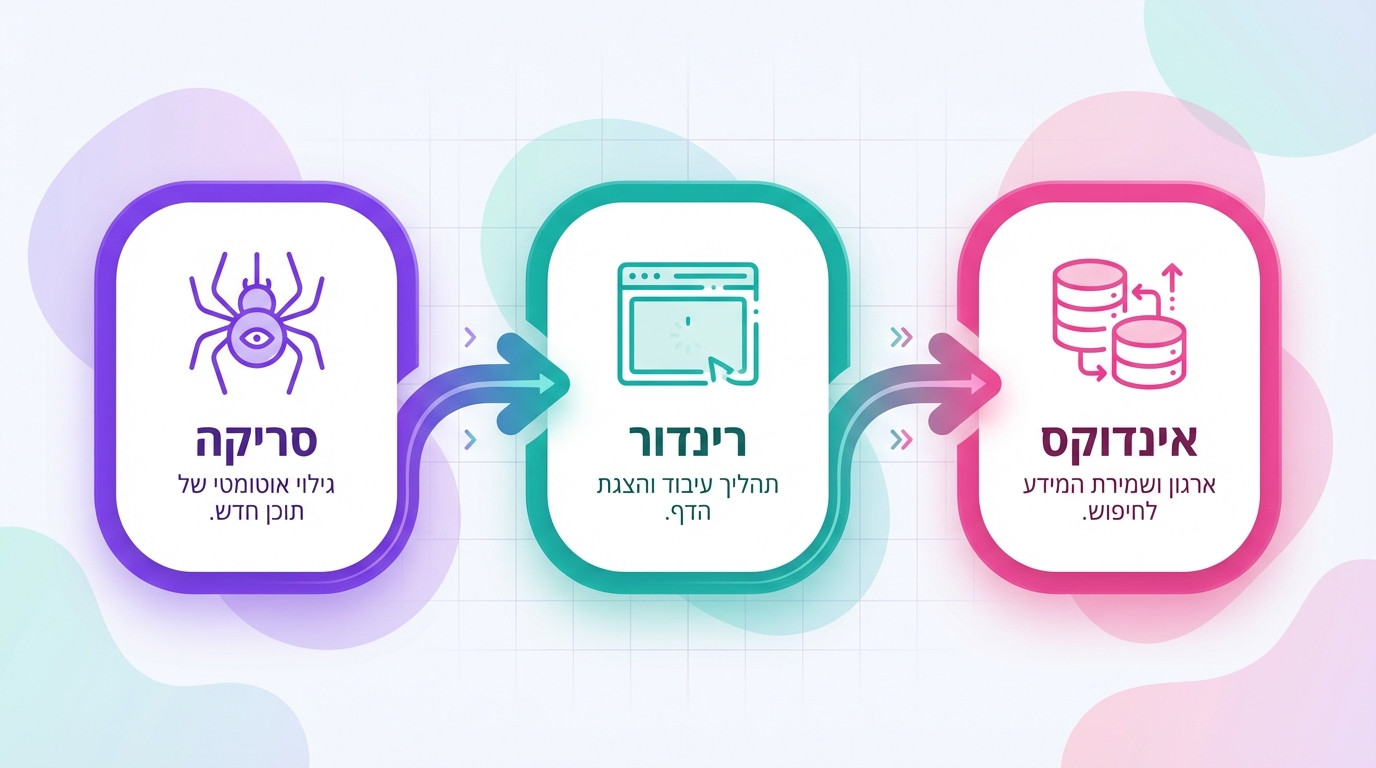

מה ההבדל בין סריקה, רינדור ואינדוקס?

שלושת המונחים האלה מתערבבים הרבה, אז בואו נשים סדר. סריקה (Crawling) היא השלב שבו הבוט של גוגל מגלה את כתובות האתר שלכם ו"מבקר" בהן. רינדור (Rendering) הוא בניית הדף כפי שהמשתמש רואה אותו – כולל הרצת JavaScript וקוד צד לקוח. אינדוקס (Indexing) הוא הכנסת התוכן למאגר הנתונים של גוגל כדי שיוכל להופיע בתוצאות חיפוש.

אתרים שמסתמכים בכבדות על JavaScript עלולים להיראות "ריקים" לסורקים בסריקה הראשונית, אם אין רינדור צד שרת. זה יוצר פער מטורף בין מה שהמשתמש רואה לבין מה שגוגל "מבין". לפי הדרישות הטכניות הרשמיות של Google, האתר חייב להיות נגיש הן לסריקה והן לרינדור.

מתי רינדור הופך לצוואר בקבוק?

כשהאתר בנוי על תבניות כבדות ב-JavaScript עם סקריפטים שחוסמים טעינה, הרינדור הופך לבעיה אמיתית. גוגל אמנם יודע לרנדר JavaScript, אבל זה לוקח לו זמן ומשאבים. לפי התיעוד הרשמי של Google על JavaScript SEO, אם קבצי JS חסומים מסריקה – גוגל לא ירנדר את הדף כלל. ההשפעה ניכרת גם במדדי Core Web Vitals: רינדור כבד פוגע ב-LCP וב-INP, מה שמוריד את חווית המשתמש ואת הדירוגים גם יחד.

השתמשו בכלי URL Inspection ב-Google Search Console ובדקו את ה-HTML המרונדר מול ה-HTML הגולמי

איך עושים Audit טכני בלי ללכת לאיבוד?

הטעות הגדולה שאני רואה שוב ושוב: אנשים מריצים סריקה עם כלי כמו Screaming Frog, מקבלים אלפי "שגיאות", ונכנסים לפאניקה. הגישה הנכונה היא תעדוף לפי השפעה עסקית. קודם כל – בודקים שהעמודים שמכניסים כסף או לידים מאונדקסים ונגישים. אחר כך מטפלים בביצועי האתר. ורק בסוף עוברים לניקוי "רעש" – כפילויות, פרמטרים מיותרים ודפים דקים.

הגישה הזו של "Prioritization" היא בדיוק מה שאנחנו ב-WEBFORCE מיישמים: המערכת מסמנת קודם כל בעיות שמונעות אינדוקס או דירוג, ורק אחר כך מציפה בעיות שמורידות יעילות. זה חוסך שעות של עבודה ומוודא שהזמן מושקע במה שבאמת מזיז את המחט.

סימנים מוקדמים לבעיות אינדוקס – לפני שהדירוגים צוללים

אל תחכו שהתנועה תיפול כדי לגלות בעיות. הסימנים המוקדמים נמצאים ב-Google Search Console: ירידה במספר העמודים המאונדקסים, עלייה בשגיאות סריקה, עמודים חשובים שנעלמו מהחיפוש – או להפך, עמודי פילטר ותוצאות חיפוש פנימיות שדווקא כן מופיעים באינדקס.

דוגמה קלאסית: קטגוריות חשובות באתר מסחר לא מאונדקסות כי תג canonical שגוי מפנה אותן למקום אחר, בזמן שמאות עמודי פילטר לא רלוונטיים דווקא נסרקים בקלילות. זה בדיוק סוג הבעיה שדורשת קידום טכני מדויק.

robots.txt חוסם אינדוקס או רק סריקה? (הטעות שכולם עושים)

הנה טעות נפוצה שאני נתקל בה כמעט בכל Audit שני: מישהו חוסם עמוד ב-robots.txt ומצפה שתגית noindex בתוך העמוד "תעבוד". אבל (ותמיד יש אבל) – robots.txt חוסם סריקה, לא אינדוקס. אם הבוט לא מורשה לגשת לעמוד, הוא לא יראה את תגית ה-noindex שבתוכו. התוצאה? העמוד עדיין עשוי להופיע בתוצאות החיפוש – בדיוק ההפך ממה שרציתם.

לפי התיעוד הרשמי של גוגל על noindex, שליטה באינדוקס נעשית דרך תגיות meta robots או כותרות HTTP כמו X-Robots-Tag – ולא דרך robots.txt.

מתי להשתמש ב-noindex ומתי בחסימת סריקה?

הכלל פשוט: noindex מתאים לדפים שגוגל צריך לסרוק אבל לא לאנדקס – כמו עמודי תודה, עמודי תוצאות חיפוש פנימיות, או דפי סינון. חסימה ב-robots.txt מתאימה לתיקיות מערכת, אזורי ניהול, ודפי טסט שטרם מוכנים לאוויר. השילוב הלא נכון בין השניים הוא מקור לאינספור תיקוני קוד ל-SEO.

איך בונים Sitemap שבאמת עוזרת ולא יוצרת רעש?

מפת אתר (Sitemap) טובה כוללת אך ורק URL-ים קנוניים, נגישים (סטטוס 200), שיש סיבה אמיתית שהם יאונדקסו. הכנסת דפים עם הפניות 301/302, שגיאות 404/5xx או כפילויות – מגדילה בלבול ומבזבזת משאבי סריקה יקרים. לפי ההנחיות הרשמיות של גוגל לבניית Sitemap, עדיף מפה קטנה ונקייה מאשר מפה ענקית מלאה בזבל.

Sitemap לאתר גדול: פיצול לפי סוגי תוכן

באתרים עם אלפי עמודים, מומלץ לפצל למפות מרובות: sitemap_pages.xml לעמודים סטטיים, sitemap_products.xml למוצרים, sitemap_posts.xml למאמרים. Sitemap Index מרכזת את כולן. הנקודה הקריטית: במיוחד באתרי מסחר דינמיים, המפה חייבת להתעדכן אוטומטית – מוצר שירד מהמדף צריך לצאת מהמפה.

Canonical שגוי – הדרך הבטוחה למחוק עמודים מהתחרות

תג Canonical אומר למנוע החיפוש: "זו הגרסה המועדפת של העמוד הזה". שימוש שגוי עלול להיות הרסני. דוגמה נפוצה מאתרי מסחר: כל הוריאציות של מוצר (צבעים, מידות) מפנות קנוניקל ישירות לעמוד הקטגוריה – מה שמאבד רלוונטיות לביטויי זנב ארוך ייחודיים. על פי הרשימה הרשמית של גוגל על טעויות נפוצות בקנוניקל, טעויות כאלה שכיחות יותר ממה שחושבים.

עוד נקודה חשובה: self-referencing canonical – תג קנוניקל שמצביע על העמוד עצמו – הוא כמעט תמיד חובה. זה מונע מצב שבו פרמטרי מעקב (כמו ?utm_source=…) יוצרים כפילויות שמבלבלות את מנוע החיפוש.

השוואה: פתרונות לתוכן כפול מפרמטרים ב-URL

פרמטרי מיון, סינון ומעקב (?sort=price, ?color=red, ?ref=affiliate) הם מקור קלאסי לכפילויות ול"בזבוז סריקה". צריך להחליט מהו ה-URL הקנוני ולצמצם יצירת וריאציות מיותרות. הנה השוואה בין הפתרונות:

הפתרון הכי טוב הוא בדרך כלל שילוב: הגבלת יצירה מלכתחילה + קנוניקל כגיבוי + קישורים פנימיים נקיים. אופטימיזציה טכנית אמיתית היא לא פתרון בודד אלא שכבות הגנה.

סריקה, רינדור, אינדוקס, robots.txt, Sitemap, Canonical ופרמטרים. עכשיו נעבור לביצועים, ארכיטקטורה ותיקוני קוד – השלב שבו באמת מזיזים דירוגים.

404 או 410: מה עדיף כשמוחקים עמוד?

כשעמוד הוסר לצמיתות ואין לו תחליף רלוונטי, קוד סטטוס 410 (Gone) שולח אות ברור יותר למנועי חיפוש להסיר את הדף מהאינדקס מהר. כשיש תחליף רלוונטי – עדיף הפניה 301 לעמוד המתאים. מה שכן, הפניה גורפת של הכל לעמוד הבית ("Soft 404 strategy") יוצרת חוויית משתמש גרועה ומבלבלת את מנועי החיפוש. זה בדיוק תרחיש שבו תיקוני קוד ל-SEO הם קריטיים ומשנים תוצאות.

301 או 302 – בחירה שנראית פשוטה ומסובכת יותר ממה שחושבים

301 (Moved Permanently) לשינויים קבועים, 302 (Found/Temporary) לשינויים זמניים – עד כאן פשוט. אבל מה שמעניין במיוחד הוא מה שקורה כשטועים: שרשרת הפניות ארוכה (301 → 301 → 200) מאטה טעינה ומבזבזת משאבי סריקה. הפניה 302 על שינוי קבוע גורמת לגוגל להתלבט מהו ה-URL הקנוני – וזה מוביל לאובדן "כוח דירוג".

תיקון שרשראות הפניה ולולאות Redirect

הפתרון: לקצר כל שרשרת הפניה ל"קפיצה אחת" ליעד הסופי. חשוב לוודא שאין הפניות דו-כיווניות או כללים מתנגשים בקובץ .htaccess. בעיות כאלה מאוד נפוצות אחרי מעבר ל-HTTPS, שינוי מבנה URL, או החלפת תבנית אתר. מי שלא בודק את זה אחרי מיגרציה – כנראה ישלם על זה בדירוגים.

ארכיטקטורת אתר: איך מוודאים שהעמודים החשובים מקבלים עדיפות?

היררכיה ברורה ואינטואיטיבית היא לא רק עניין של UX – היא קריטית ל-SEO. עמוד שנמצא "עמוק" מדי בהיררכיית האתר (5+ קליקים מעמוד הבית) ייסרק פחות ויקבל פחות "כוח" פנימי. הפתרון: מצמצמים עומק קליקים לעמודים חשובים ומחזקים קישורים פנימיים לעמודי "כסף" ולידים.

כדי לנהל את זה ביעילות, במיוחד באתרים מורכבים, מערכת WEBFORCE לניהול משימות קידום אתרים מאפשרת לעקוב אחרי ביצוע התיקונים האלה בצורה מסודרת ולוודא שמבנה האתר אכן מותאם לאסטרטגיה.

חוק 3-4 קליקים: מתי הוא נכון ומתי פחות?

"כל עמוד חשוב צריך להיות נגיש תוך 3-4 קליקים מעמוד הבית" – זו המלצה כללית טובה, אבל לא חוק ברזל. באתרי ענק עם עשרות אלפי עמודים, זה לא תמיד אפשרי. מה שבאמת חשוב יותר מ"מספר קליקים" הוא שהעמודים החשובים מקבלים קישורים פנימיים רבים ואיכותיים מעמודים בעלי ערך – זה מה שמעביר קידום טכני אמיתי.

איך קישורים פנימיים משפיעים על הכל – סריקה, אינדוקס ודירוג

קישורים פנימיים הם מערכת הניווט של הסורקים והמשתמשים גם יחד. הם עוזרים לבוטים לגלות עמודים חדשים, להבין היררכיה וקשרים בין עמודים, ולהעביר "כוח" (PageRank) פנימי. שימוש בעוגן (anchor text) רלוונטי מספק קונטקסט נוסף למנוע החיפוש על העמוד המקושר. אל תזלזלו בכוח של קישור פנימי טוב – הוא שווה לעיתים יותר מקישור חיצוני בינוני.

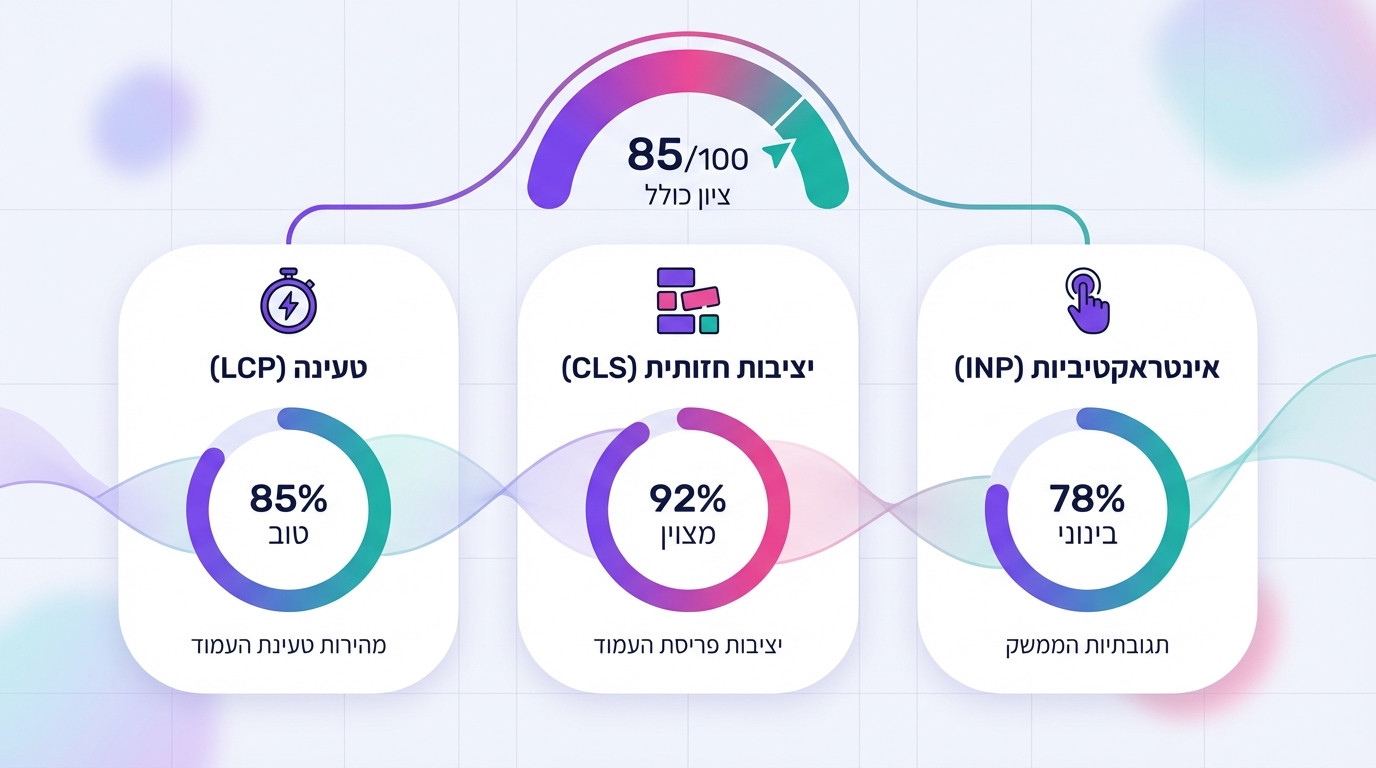

Core Web Vitals: מדדי הביצועים שגוגל באמת מודדת

Core Web Vitals (CWV) הם קבוצת מדדים שגוגל משתמשת בהם להערכת חווית המשתמש. LCP (Largest Contentful Paint) מודד זמן טעינת האלמנט הגדול ביותר. CLS (Cumulative Layout Shift) מודד יציבות ויזואלית. ומאז מרץ 2024, INP (Interaction to Next Paint) החליף את FID כמדד האינטראקטיביות המרכזי. לפי web.dev, INP מודד את התגובתיות הכוללת של הדף לאורך כל הביקור – לא רק את האינטראקציה הראשונה.

איך לבדוק ולשפר את Core Web Vitals?

כלי הבדיקה: PageSpeed Insights, Lighthouse, ודוחות CWV ב-Google Search Console. טיפים מעשיים:

- דחיסת תמונות ומעבר לפורמטים מודרניים (WebP/AVIF)

- שימוש ב-Lazy Loading לתמונות מתחת לקו הגלילה

- דחיית JavaScript לא קריטי באמצעות defer ו-async

- אופטימיזציית CSS – הסרת קוד לא בשימוש והטענת Critical CSS ישירות

- הטמעת CDN לקיצור מרחק פיזי מהשרת למשתמש

אופטימיזציה טכנית של הדברים האלה משפיעה ישירות גם על דירוגים וגם על שיעורי המרה.

Schema Markup: מה נתונים מובנים עושים לתוצאות החיפוש שלכם?

Schema Markup הוא קוד סמנטי שמסייע למנועי חיפוש להבין את התוכן בצורה טובה יותר ומאפשר "Rich Results" – תוצאות מועשרות עם כוכבי דירוג, מחירים, שאלות ותשובות ועוד. ההשפעה על ה-CTR יכולה להיות דרמטית: תוצאה מועשרת בולטת הרבה יותר בדף התוצאות ומושכת יותר קליקים. זה חלק בלתי נפרד מ-SEO טכני מתקדם.

סוגי סכמה נפוצים:

- Product Schema – למוצרים עם מחיר, זמינות ודירוג

- Review Schema – לביקורות עם כוכבי דירוג

- FAQ Schema – לשאלות נפוצות שמופיעות ישירות בתוצאות

- Organization Schema – לפרטי עסק ומידע מותגי

- Article Schema – למאמרים וכתבות

כלי בדיקה: Google's Rich Result Test ו-Schema Markup Validator.

"תקציב סריקה" (Crawl Budget) – מיתוס או מציאות?

מציאות – אבל לא לכולם. תקציב סריקה הוא מספר הדפים שגוגל מוכן לסרוק באתר שלכם בזמן נתון. עבור אתרים קטנים (עד כמה מאות עמודים), זה בדרך כלל לא הבעיה. אבל באתרים עם אלפי עמודים – במיוחד אתרי מסחר עם פילטרים ופרמטרים – ניהול נכון של Crawl Budget חיוני. הפתרון כולל חסימת עמודים לא חשובים, טיפול בפרמטרים מיותרים, הסרת תוכן דק, ושיפור מהירות טעינה.

SEO טכני מתקדם לוורדפרס: מלכודות ייחודיות

אתרי וורדפרס מצריכים התייחסות מיוחדת. התלות בתוספים ובתבניות יוצרת מצבים ייחודיים: תוסף כבד מדי מאט את האתר, תבנית לא מותאמת מייצרת קוד מנופח, ותוספי SEO כמו Yoast או Rank Math – למרות שהם מעולים לניהול תגי מטא וקנוניקל – לא פותרים בעיות קוד בסיסיות או ביצועים.

הפתרון: בחירת תבנית קלת משקל, מינימום תוספים, ובדיקה קבועה של ביצועים. לניהול יעיל של כלל היבטי ה-SEO הטכני, במיוחד כשמדובר באתרי וורדפרס מרובים, מערכת WEBFORCE ל-Multi-site SEO מאפשרת לנטר ולנהל הכל ממקום אחד – בלי לקפוץ בין דשבורדים.

תיקוני קוד ל-SEO: מתי חייבים לגעת בקוד עצמו?

תיקוני קוד ל-SEO נדרשים כשהבעיות חורגות ממה שאפשר לפתור עם הגדרות, תוספים, או קבצי תצורה. מדובר בתיקונים ברמת קוד המקור – HTML, CSS, JavaScript – שמשפיעים על נגישות סריקה, מהירות טעינה ורינדור. זה כולל טיפול ב-render-blocking resources, אופטימיזציית פונקציות JavaScript כבדות, תיקון תגיות HTML שגויות (alt חסר, כותרות כפולות), ועוד.

עבור ניהול מתקדם של אינדוקס, סריקה ותיקוני קוד, פלטפורמת WEBFORCE – לוח בקרה לקידום אתרים מספקת תמונת מצב ברורה של כל הבעיות הטכניות ומתעדפת את מה שדורש טיפול מיידי.

תעדפו לפי השפעה: קודם בעיות אינדוקס (מונעות הופעה בכלל), אחר כך ביצועים (משפיעים על דירוג וחוויה), ולבסוף ניקוי ואופטימיזציה (משפרים יעילות). הגישה הזו חוסכת זמן וממקסמת תוצאות.

שאלות נפוצות בנושא SEO טכני מתקדם

רוצים לדעת אם האתר שלכם סובל מבעיות טכניות שפוגעות בדירוגים?

ברוב המקרים, הבעיות הטכניות שמשפיעות הכי הרבה על דירוגים הן דווקא אלה שהכי קשה לזהות בלי כלים מתאימים ועין מקצועית. מערכת WEBFORCE מבית Webs מאפשרת לזהות בעיות סריקה, אינדוקס וביצועים בצורה אוטומטית, עם תעדוף לפי השפעה עסקית – וזה בדיוק ההבדל בין "לתקן הכל" לבין "לתקן את מה שבאמת משנה".

הגעתם עד לכאן – כל הכבוד. עכשיו הזמן ליישם. התחילו מבעיה אחת, תקנו אותה, ותראו את ההבדל.