אחרי שנים של עבודה עם אתרי JavaScript מורכבים, אני יכול להגיד לכם דבר אחד בוודאות: הטכנולוגיה לא "הורגת" SEO — חוסר הבנה של הטכנולוגיה הורג SEO. מאז 2014 אני עובד עם עסקים ישראליים שבנו אתרים מדהימים ב-React או Angular, אבל גילו שגוגל פשוט לא רואה את התוכן שלהם. האמת המרה? ברוב המקרים הבעיה לא בפלטפורמה — היא באסטרטגיית הרינדור. במדריך הזה אני הולך לפרק את כל מה שצריך לדעת על קידום אתרי JavaScript, בלי בולשיט ובלי הבטחות ריקות.

זמן קריאה משוער: 18 דקות — בסיום תקבלו צ׳ק-ליסט מלא ליישום מיידי

נקודות מפתח שתקחו מהמדריך הזה

- ✓ איך לזהות תוך 10 דקות אם גוגל רואה את התוכן באתר ה-JavaScript שלכם

- ✓ ההבדל בין CSR, SSR, SSG ו-Pre-render — ומתי להשתמש בכל אחד

- ✓ שש הטעויות הקריטיות שמונעות אינדוקס ואיך לתקן אותן

- ✓ אסטרטגיות קידום ספציפיות ל-React ול-Angular

- ✓ שיפור Core Web Vitals באתרי JavaScript — הצעדים שעובדים

מה זה קידום אתרי JavaScript ולמה זה שונה מ-SEO "רגיל"?

באתר HTML "קלאסי", מנוע החיפוש שולח בקשה לשרת, מקבל חזרה מסמך HTML מלא עם כל התוכן — כותרות, טקסטים, קישורים — והכל שם, מוכן לאינדוקס. זה פשוט. באתרי JavaScript המצב שונה לחלוטין: השרת שולח מסמך HTML שברוב המקרים כמעט ריק, ואז קוד ה-JavaScript בדפדפן (או אצל הסורק) "בונה" את התוכן בזמן אמת. ההבדל המרכזי הוא מתי ואיך התוכן הופך לגלוי למנועי חיפוש. וזה, חברים, עושה את כל ההבדל בעולם.

מתי קידום JavaScript קריטי במיוחד?

כל עמוד שאמור להביא תנועה אורגנית צריך אסטרטגיית JavaScript SEO מותאמת. מדובר באתרי תוכן עשירים, בלוגים, קטגוריות מוצרים בחנויות אונליין, עמודי נחיתה, פורטלים ועמודי שירות. אם בניתם אפליקציית SPA יפהפייה אבל גוגל לא מאנדקס את עמודי המוצרים שלכם — יש בעיה. ואם אתם לא בטוחים אם יש לכם בעיה כזו, המשיכו לקרוא.

טיפ מקצועי: לפני שמתחילים לשנות ארכיטקטורה, בדקו ב-Google Search Console כמה עמודים באמת מאונדקסים מול כמה עמודים קיימים באתר. פער גדול מצביע על בעיית JavaScript SEO.

האם גוגל באמת יודע לקרוא JavaScript?

כן. גוגל מסוגל לבצע רינדור של JavaScript. הוא משתמש ב-Web Rendering Service (WRS) שפועל כמו גרסת כרום, סורק את הדף ומריץ את הסקריפטים. אבל (ותמיד יש אבל) — זה לא קורה מיד ולא תמיד בצורה מושלמת. התהליך עובד ב"שני גלים": בגל הראשון, גוגלבוט סורק את ה-HTML הגולמי. בגל השני, העמוד נכנס לתור רינדור, שם ה-JavaScript מורץ והתוכן הדינמי נוצר. לפי התיעוד הרשמי של גוגל, הפער בין שני הגלים עלול להימשך ימים ואף שבועות.

פלטפורמת WEBFORCE מבית Webs כוללת כלים לניטור וזיהוי פערים כאלו בין סריקה לרינדור, כך שאפשר לטפל בהם באופן יזום במקום לגלות שמשהו שבור רק כשהתנועה האורגנית צונחת.

חשוב לזכור: גוגל מסוגל להריץ JavaScript — אבל "מסוגל" לא אומר "תמיד עושה את זה בזמן ובצורה מושלמת". ההסתמכות על תהליך הרינדור של גוגל היא הימור שלא כדאי לקחת.

למה אתר JavaScript לא מתאנדקס (או מתאנדקס חלקית)?

הנה הסיבות שאני רואה שוב ושוב בפרויקטים: ה-HTML הראשוני של האתר דל בתוכן, התוכן הקריטי נטען מאוחר מדי, או שהניווט והקישורים הפנימיים פשוט לא נגישים לסורקים. ומה שמעצבן? ברוב המקרים אף אחד לא שם לב עד שזה כבר עולה בכסף אמיתי.

זיהיתם את אחת הבעיות מהרשימה? אל תחכו

כל יום שעובר בלי תיקון הוא יום של אובדן תנועה אורגנית ולקוחות פוטנציאליים

"View Source" מול "Inspect": הטריק הכי פשוט לזיהוי בעיות

הנה סוד קטן שחוסך שעות של אבחון: לחצו Ctrl+U (או Cmd+Option+U במק) כדי לפתוח את "הצג מקור דף". זה מה שגוגלבוט רואה בגל הראשון — HTML גולמי, לפני שום JavaScript. עכשיו לחצו F12 ותפתחו את "בדיקת אלמנט" (Inspect). זה ה-DOM המרונדר, אחרי שכל ה-JavaScript רץ. אם התוכן הקריטי שלכם — כותרות, טקסטים, קישורים — מופיע רק ב-Inspect ולא ב-View Source, יש לכם בעיית קידום אתרי JavaScript קלאסית.

פעולה מיידית: פתחו עכשיו את העמוד החשוב ביותר באתר שלכם, לחצו Ctrl+U, וחפשו את מילת המפתח הראשית. אם היא לא שם — יש לכם בעיה דחופה לפתור.

איזה כלים חושפים מה גוגל באמת רואה בעמוד?

Google Search Console הוא הכלי המרכזי. השתמשו ב"בדיקת כתובות URL" (URL Inspection Tool) כדי לראות את גרסת ה-HTML שגוגלבוט סרק ורינדר. לפי עדכון גוגל משנת 2021, הכלי מציג צילום מסך ו-Headers מדויקים של מה שהסורק קיבל. בנוסף, השתמשו ב-Rich Results Test כדי לוודא שנתונים מובנים (Schema) מרונדרים כמו שצריך, ובדוח Crawl Stats כדי לזהות בעיות נגישות וסטטוסים חריגים.

צ׳ק-ליסט אבחון מהיר (10 דקות)

פתחו את העמוד בכרום. לחצו "View Source" וחפשו את מילת המפתח הראשית, כותרות H1/H2, תיאור meta וקישורים פנימיים חשובים. אם הם חסרים — יש בעיה. עברו ל-Google Search Console, הכניסו את ה-URL, והשוו בין ה-HTML המקורי ל-Rendered HTML. ודאו שאין הודעות שגיאה קריטיות. כל התהליך לוקח פחות מעשר דקות וחוסך כאבי ראש של חודשים.

מערכת WEBFORCE מבית Webs מציעה ניטור ודיווח אוטומטי על בעיות סריקה ורינדור — במקום לבצע את הבדיקות האלה ידנית כל פעם, המערכת מתריעה כשמשהו נשבר.

סיכום ביניים: עד כאן הבנו שגוגל כן יכול לקרוא JavaScript, אבל לא תמיד ולא מיד. המפתח הוא לספק HTML מלא מהרגע הראשון — ולא להסתמך על תהליך רינדור שלא בשליטתכם.

מה זה SPA SEO ולמה אתרי SPA מתקשים בקידום?

Single Page Application — אתר שטוען דף HTML אחד בודד ומשנה את התוכן דינמית באמצעות JavaScript, בלי ריענון דף. זה מעולה לחווית משתמש, אבל בעיני מנועי חיפוש ה"עמודים" הם למעשה נתיבים (routes) דינמיים ולא דפים פיזיים נפרדים.

סורקי גוגל עלולים להתקשות לגלות ולאנדקס את כל הנתיבים, מטא-דאטה לכל נתיב דורש טיפול מיוחד, וקישורים פנימיים שמבוססים על JavaScript בלבד עלולים להיות "בלתי נראים" לסורקים. ובמקביל, אתרי SPA נוטים להתקשות גם במדדי Core Web Vitals אם לא מיושמים נכון.

טיפ מקצועי: אם יש לכם אתר SPA קיים ואתם לא יכולים לשכתב אותו — התחילו מ-Pre-rendering לעמודים הקריטיים ביותר. זה הפתרון המהיר ביותר לשיפור אינדוקס.

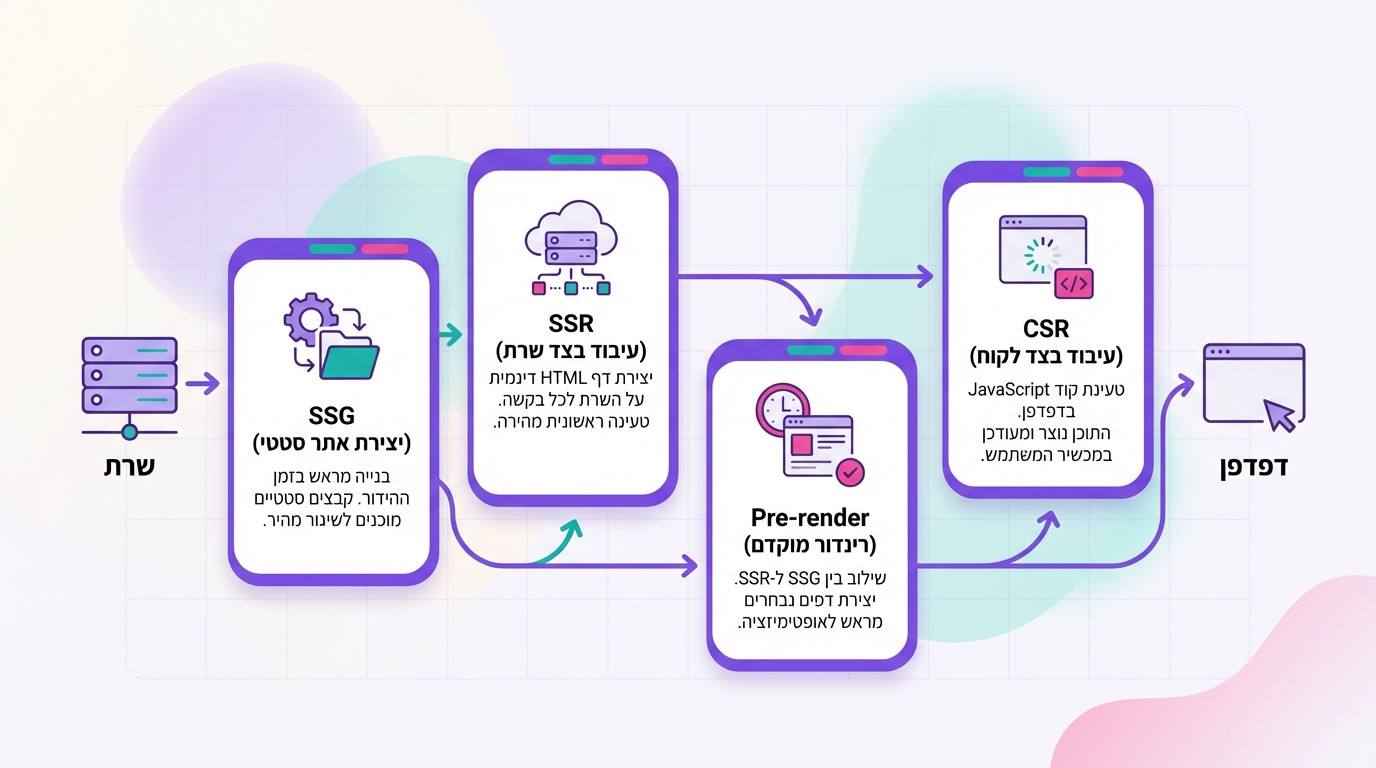

השוואה: CSR, SSR, SSG ו-Pre-render — מה עושה מה?

מודל הרינדור שבוחרים משפיע ישירות על הנגישות של התוכן למנועי חיפוש. הנה הפירוט:

CSR שולח HTML כמעט ריק — הדפדפן בונה הכל. אידיאלי פחות לעמודי SEO. SSR (כמו Next.js ל-React) מרנדר בשרת ושולח HTML מלא — ידידותי למנועי חיפוש. SSG בונה את ה-HTML מראש בזמן ה-build, מה שמספק מהירות יוצאת דופן ונגישות מלאה לסורקים. Pre-rendering הוא פתרון ביניים שמאפשר לאתרי SPA קיימים ליצור HTML מראש לנתיבים נבחרים, בלי לשכתב את כל האפליקציה.

המלצה: אם אתם מתחילים פרויקט חדש — בחרו ב-Next.js (React) או Angular Universal עם גישת Hybrid שמשלבת SSR ו-SSG. זה מספק את הגמישות הרבה ביותר לקידום.

מהו WEBFORCE מבית Webs ואיך הוא קשור לקידום אתרי JavaScript?

WEBFORCE היא פלטפורמה ומתודולוגיית עבודה שמיועדת לייעל את תהליכי הקידום ולהפוך אתרים דינמיים לידידותיים למנועי חיפוש. במקום לנחש מה עובד ומה לא, המערכת מספקת:

- מיפוי ואפיון של עמודי SEO קריטיים

- המלצה על אסטרטגיית רינדור מתאימה לכל סוג דף

- ניהול מטא-דאטה וסכמות בצורה סטנדרטית

- אופטימיזציית קישורים פנימיים

- כלי ניטור ובקרה עם התראות בזמן אמת

למידע נוסף על פתרונות אוטומטיים לדוחות וניהול קידום אתרים, כדאי להכיר את מערכת WEBFORCE המיועדת גם לחברות SEO — ניהול קידום מספר אתרים | WEBFORCE ל-Multi-site SEO.

מה יוצא ללקוח בפועל משימוש ב-WEBFORCE?

תיעדוף משימות פיתוח ואופטימיזציה עם הבנה ברורה של ההשפעה על SEO. צ׳ק-ליסטים מפורטים להטמעת שינויים ובדיקות איכות. תוכנית ניטור שוטפת לזיהוי ותיקון תקלות אינדוקס וסריקה לפני שישפיעו על הדירוג — ושיפור ממשי בנראות ובתנועה האורגנית. הכירו את לוח הבקרה המתקדם של WEBFORCE.

רוצים לראות איך WEBFORCE יכול לעזור לאתר שלכם?

אבחון ראשוני ללא התחייבות — בואו נבדוק ביחד מה גוגל באמת רואה באתר שלכם

איך עושים קידום React בצורה נכונה?

העיקרון הראשון: הפרידו בין עמודי יישום לבין עמודי SEO. לא כל דף באתר React צריך SSR — דשבורדים ואזורי משתמש יכולים להישאר CSR. אבל עמודי תוכן, מוצרים ושירותים חייבים לקבל HTML מלא. השתמשו ב-Next.js שמאפשר SSR או SSG לפי צורך, כך שגוגלבוט מקבל קוד HTML זמין מראש.

הטמיעו ניהול מטא-דאטה ייחודי לכל נתיב באמצעות React Helmet או ה-Head component של Next.js. ודאו שה-routes מוגדרים עם History API כדי לייצר URLs נקיים, הגדירו Canonical URL נכון לכל עמוד, ואל תסתמכו על Lazy Load קיצוני לתוכן קריטי — גוגל לא "לוחץ" על כפתורים כדי לגלות תוכן.

טיפ מקצועי: ב-Next.js, השתמשו ב-getStaticProps לעמודי תוכן שלא משתנים בתדירות גבוהה וב-getServerSideProps לעמודים דינמיים. שילוב נכון של השניים הוא המפתח לקידום React אופטימלי.

הטעות הנפוצה ביותר ב-React SEO

תאמינו לי, עשיתי את כולן. אבל הטעות שאני רואה הכי הרבה היא פשוטה להחריד: עמוד שנראה מעולה למשתמש אבל "ריק" לחלוטין במקור ה-HTML. Client-Side Rendered בלבד, בלי שום אסטרטגיית SSR או SSG. זה כמו לבנות חנות מדהימה בקומה 30 בלי שלט ובלי מעלית — אף אחד לא יגיע. זהו החסם הגדול ביותר מול קידום React יעיל.

חשוב לזכור: CSR לא אומר "אי אפשר לדרג" — אבל זה אומר שאתם תלויים לחלוטין ביכולת הרינדור של גוגל. בעמודים עסקיים קריטיים, זה סיכון שלא שווה לקחת.

איך עושים קידום Angular בצורה נכונה?

הצעד הראשון: הטמעת Angular Universal לרינדור בצד שרת או ל-Pre-rendering. לפי התיעוד הרשמי של Angular, בחירת אסטרטגיית הרינדור תלויה בסוג העמוד — דפי תוכן ונחיתה צריכים SSR/SSG, בעוד אזורים אינטראקטיביים יכולים להישאר CSR. ודאו שה-router משתמש ב-History API ליצירת URLs נקיים ללא Hashbangs, וצרו Sitemap שמכיל את כל ה-URLs החשובים.

נקודה חשובה: השתמשו ב-Title Service וב-Meta Service של Angular לניהול כותרות ותיאורים ייחודיים לכל נתיב, וודאו שהאתר מטפל בקודי סטטוס HTTP כראוי (404, 301) כדי למנוע בעיות אינדוקס.

למה Angular "מרגיש" קשה יותר לפעמים?

Angular ידוע במורכבות התצורה שלו. היישום של Angular Universal דורש שיחה ישירה עם מפתחים, ותלויות הרינדור יכולות להוסיף אתגר. מתודולוגיית WEBFORCE מבית Webs מפשטת את התהליך באמצעות הכוונות ברורות לצוותי הפיתוח וכלים למעקב שוטף אחר קידום Angular.

המלצה: בפרויקטי Angular, הגדירו מראש אילו נתיבים צריכים SSR ואילו יכולים להישאר CSR. שילוב הגדרות Prerender ב-angular.json יכול לחסוך שעות עבודה בהמשך.

Dynamic Rendering — פתרון זמני או מלכודת?

Dynamic Rendering הוא גישה שבה השרת מזהה מי ביקר (גוגלבוט או משתמש רגיל) ומגיש גרסה שונה: לבוטים — HTML מרונדר מראש, למשתמשים — אפליקציית JavaScript רגילה. גוגל עצמו מגדיר את זה כ-workaround ולא כפתרון לטווח ארוך.

היתרון: פתרון מהיר לאתרי SPA קיימים. החסרונות: דורש תחזוקה שוטפת כדי לוודא שאין פערים בין מה שהבוט רואה למה שהמשתמש רואה. אם הפערים גדולים מדי, גוגל עלול לפרש זאת כ-Cloaking (הטעיה) ולנקוט בפעולה ענישתית. בשורה התחתונה: השתמשו בזה רק כשאין ברירה — SSR/SSG עדיפים.

סיכום ביניים: Dynamic Rendering הוא פלסטר, לא פתרון. אם האתר שלכם חדש או עובר שדרוג — השקיעו ב-SSR/SSG מההתחלה. אם יש לכם אתר SPA קיים שחייב תיקון מהיר — Dynamic Rendering יכול לעזור בטווח הקצר.

ניהול מטא תגיות באתר SPA — תרחיש שכולם שוכחים

תגיות title ו-meta description הן קריטיות ל-CTR בתוצאות החיפוש. ב-SPA, מכיוון שהעמוד לא נטען מחדש, יש צורך בפתרונות JavaScript ספציפיים. ב-React — React Helmet או Next.js Head component. ב-Angular — Title Service ו-Meta Service הרשמיים. הנקודה הקריטית: ודאו באמצעות URL Inspection Tool שגוגלבוט אכן רואה את המטא-דאטה הנכון לאחר הרינדור. ראיתי לא מעט אתרים שבהם כל עמוד מציג את אותה כותרת כי המטא לא עודכן דינמית.

פעולה מיידית: בדקו עכשיו 5 עמודים שונים באתר שלכם ב-View Source. אם כולם מציגים אותה תגית title — זו בעיה דחופה שפוגעת ב-CTR שלכם בתוצאות החיפוש.

קישורים פנימיים ב-JavaScript — הכלל שאסור לשבור

קישורים פנימיים הם עמוד השדרה של ארכיטקטורת האתר. הם מאפשרים לסורקים לגלות עמודים חדשים ולהעביר "כוח קידום" (PageRank). הכלל הבסיסי: כל קישור שברצונכם שייסרק חייב להיות תגית a עם מאפיין href תקני. הימנעו מקישורים שמבוססים על אירועי onclick או javascript:void(0) ללא href. גם כפתורים שמובילים ל-URLs חייבים להיות מיושמים כקישורים תקניים — אחרת גוגל פשוט לא יראה אותם.

חשוב לזכור: ב-React השתמשו ב-Link component של Next.js או React Router שמייצר תגית a תקנית. ב-Angular, ודאו שה-routerLink מרנדר href תקני ב-HTML הסופי. בדקו את זה תמיד ב-View Source.

שש הטעויות שמונעות אינדוקס באתרי JavaScript

1. תוכן שנטען באיחור: CSR ללא אסטרטגיית SEO — גוגל מקבל עמוד ריק.

2. חסימת קבצים חיוניים: robots.txt שחוסם JS או CSS — גוגל לא יכול לרנדר.

3. noindex שגוי: תגית שנשתלה בטעות מונעת אינדוקס של עמודים חשובים.

4. Soft 404: עמודים ריקים שמחזירים סטטוס 200 — בזבוז Crawl Budget.

5. קישורים שבורים: ניווט שלא משתמש בתגיות a תקניות.

6. זמני טעינה איטיים: גוגל עלול לוותר על רינדור של עמודים כבדים מדי.

מערכת WEBFORCE מספקת ניטור מתמיד שמזהה את כל הבעיות האלה בזמן אמת, כך שאפשר לתקן לפני שהדירוג נפגע.

אם זיהיתם אפילו טעות אחת מתוך השש — אתם מפסידים תנועה

רוב הטעויות האלה ניתנות לתיקון תוך ימים — ההשפעה יכולה להיות דרמטית

כמה זמן לוקח לגוגל לאנדקס אתר JavaScript?

זה משתנה, ואין תשובה אחת. זמן האינדוקס תלוי ב-Crawl Budget שגוגל מקדיש לאתר (חשוב במיוחד לאתרים גדולים), בתדירות העדכון, במורכבות הטכנית של הרינדור, ובאיכות האתר והסמכותיות שלו. בתהליך "שני הגלים" של גוגל, עשויים לעבור ימים ואף שבועות בין הסריקה הראשונית לבין רינדור ה-JavaScript ואינדוקס התוכן במלואו. שימוש ב-SSR/SSG מזרז את התהליך משמעותית — במקרים רבים, מדובר בהבדל דרמטי.

טיפ מקצועי: לאחר שינויים גדולים באתר JavaScript, הגישו את ה-Sitemap המעודכן ב-Search Console ובקשו אינדוקס ידני לעמודים הקריטיים ביותר. זה לא מבטיח אינדוקס מהיר, אבל מפנה את תשומת הלב של גוגל.

האם מפת אתר (Sitemap) חובה ב-SPA?

בהחלט כן. ב-SPA הניווט תלוי ב-JavaScript וייתכן שלא כל הקישורים יתגלו על ידי סורקים בדרך הרגילה. מפת אתר עוזרת לגוגל לגלות את כל ה-URLs החשובים, ומפה מעודכנת מרמזת על שינויים ותוספות. ודאו שהמפה מכילה רק URLs קנוניים ואינה כוללת דפים עם noindex — אחרת אתם פשוט מבזבזים את "תקציב הסריקה" שלכם.

Pagination וגלילה אינסופית — איך לא "להסתיר" תוכן מגוגל?

גוגל לא "גולל" ולא "לוחץ" על כפתורים. אם התוכן שלכם נחשף רק באינטראקציה — הוא בלתי נראה לסורקים. הפתרונות:

- בפג׳ינציה קלאסית: השתמשו בקישורי a תקניים לכל עמוד

- בכפתור "טען עוד": ודאו שכל פריטי התוכן קיימים ב-Sitemap עם URLs ייחודיים

- בגלילה אינסופית: הציעו גם פג׳ינציה קלאסית כחלופה ובדקו עם URL Inspection שכל התוכן הרלוונטי נראה ב-Rendered HTML

שיפור Core Web Vitals באתר React או Angular

Core Web Vitals — LCP, FID, CLS — הם מדדי חווית משתמש שגוגל לוקח בחשבון בדירוג. אתרי JavaScript שמבוססים על CSR נוטים להתקשות במדדים האלה. הפתרונות העיקריים:

- מעבר ל-SSR/SSG שמספקים HTML מלא מיד (שיפור דרמטי ב-LCP)

- מיטוב קוד JavaScript באמצעות דחיסה ופיצול קוד (Code Splitting)

- אופטימיזציית תמונות ופונטים עם פורמטים מודרניים כמו WebP

- שימוש ברמזי Preconnect/Preload לחיבור מוקדם למקורות קריטיים

טיפ מקצועי: הריצו את PageSpeed Insights על 5 העמודים החשובים ביותר שלכם. תעדפו את הבעיות לפי השפעה — LCP הוא בדרך כלל המדד שמשפיע הכי הרבה על הדירוג ועל חווית המשתמש.

שאלות נפוצות (FAQ)

הצעדים הבאים שלכם

רוצים לדעת אם האתר שלכם סובל מבעיות אינדוקס בגלל JavaScript? אם התוכן שלכם נטען דינמית ואתם לא בטוחים מה גוגל רואה — הגיע הזמן לבדוק.

צרו קשר עם הצוות שלנו לאבחון ראשוני ללא התחייבות

דברו איתנו כאן — ונראה ביחד מה אפשר לשפר